传统大模型虽能生成流畅文本,却存在两大硬伤:其一,依赖预训练数据,对企业私有知识(如产品手册、客户案例、合规文档)“一问三不知”;其二,生成内容可能脱离实际数据,出现“编造事实”的“幻觉”。点此进入芝麻小客服官网

这对金融、医疗、法律等对知识准确性要求极高的行业而言,几乎是致命缺陷。

-

降本:减少人工整理FAQ、重复回答客户问题的时间; -

提效:销售、客服、技术支持团队可快速调用最新产品资料,响应速度提升50%以上; -

控险:所有回答基于企业合规文档,避免因信息错误引发的法律或声誉风险。

一、搭建企业专属RAG知识库

1. 接入AI大模型

ChatWiki已集成GPT-4、Claude、DeepSeek、文心一言、火山引擎等20+国内外大模型,企业可根据业务场景或成本考量自由切换。只需在后台配置模型API Key,即可便捷完成接入。

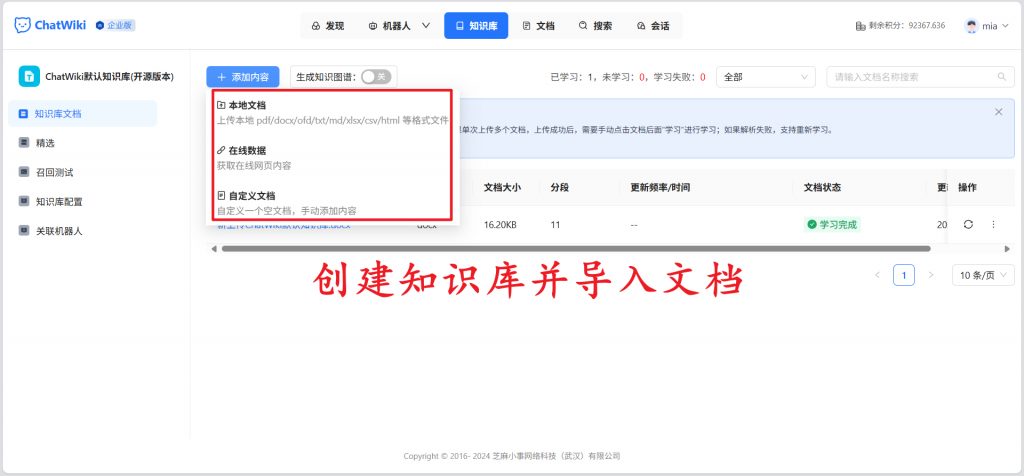

2. 创建知识库

企业可将ODF、PDF、Word、Excel、TXT甚至网页链接等格式的文档批量上传至ChatWiki。

系统会自动对导入的文本数据进行预处理、向量化或 QA 分割。

比如针对FAQ类文档,自动抽取“问题-答案”对,优化特定场景的问答精准度。

3. 创建AI机器人

完成知识库构建后,企业可在ChatWiki中快速创建AI机器人,为其命名(如“小X客服”“产品专家”)并关联目标知识库。

系统自动生成对话界面,支持自定义欢迎语、引导语,甚至调整回答风格(如“专业严谨”或“亲切口语化”)。

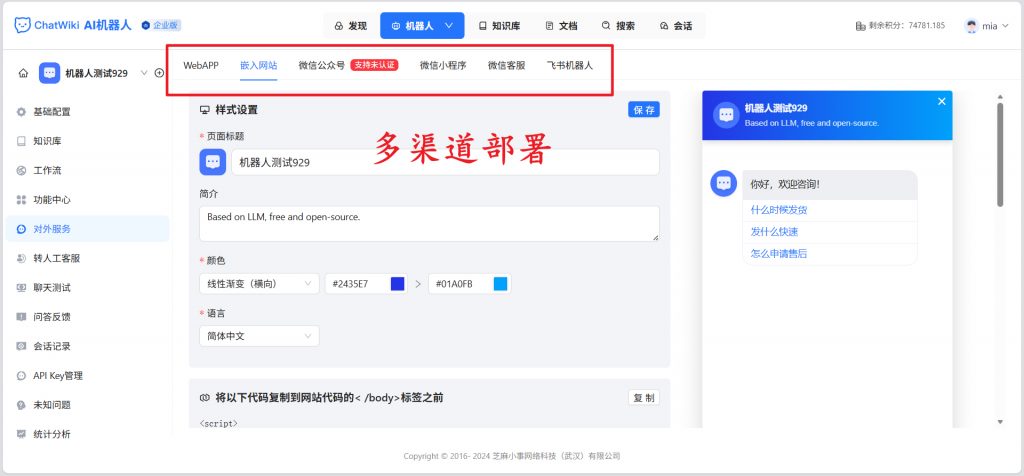

4. 多渠道部署

本地化使用:提供桌面客户端,支持内部员工离线调用知识库。

某制造企业曾通过ChatWiki,将产品手册知识库同步至官网、经销商小程序和内部OA,客户咨询响应率提升40%,经销商培训时间缩短60%。

5. 权限管理

二、ChatWiki如何适配企业差异化需求?

了解更多功能详情,

获取功能试用,请扫码联系

原创文章,作者:小芝麻,如若转载,请注明出处:https://xiaokefu.com.cn/blog/35081.html